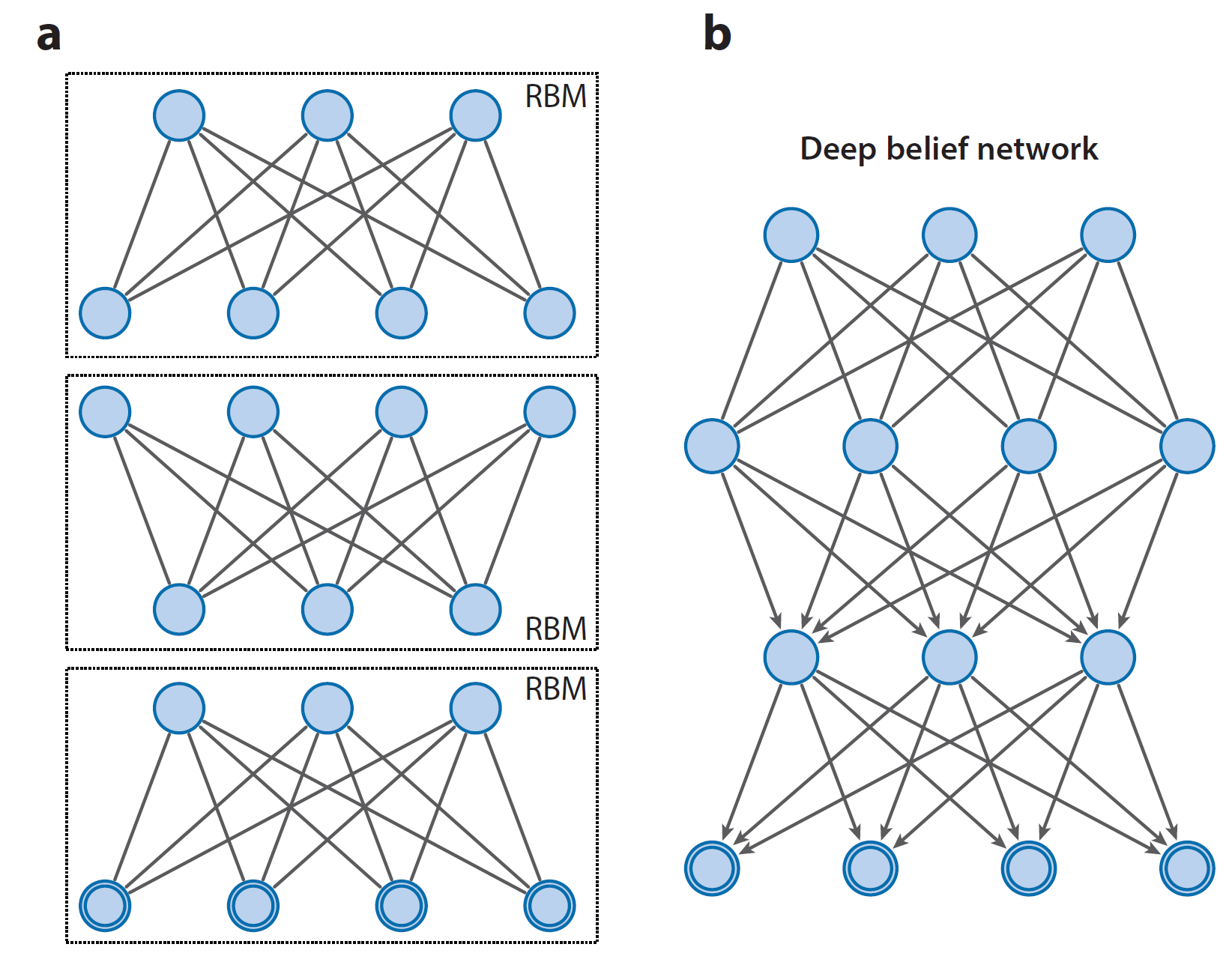

深层信念网络 Deep Belief Networks

由多层 RBM 构成的网络,具有生成能力。

因为结构较为复杂,目前已经很少使用。图像处理一般使用 CNN 而时序数据处理一般使用 RNN

参考:Deep Belief Networks (DBNs)

结构

由两个部分组成:

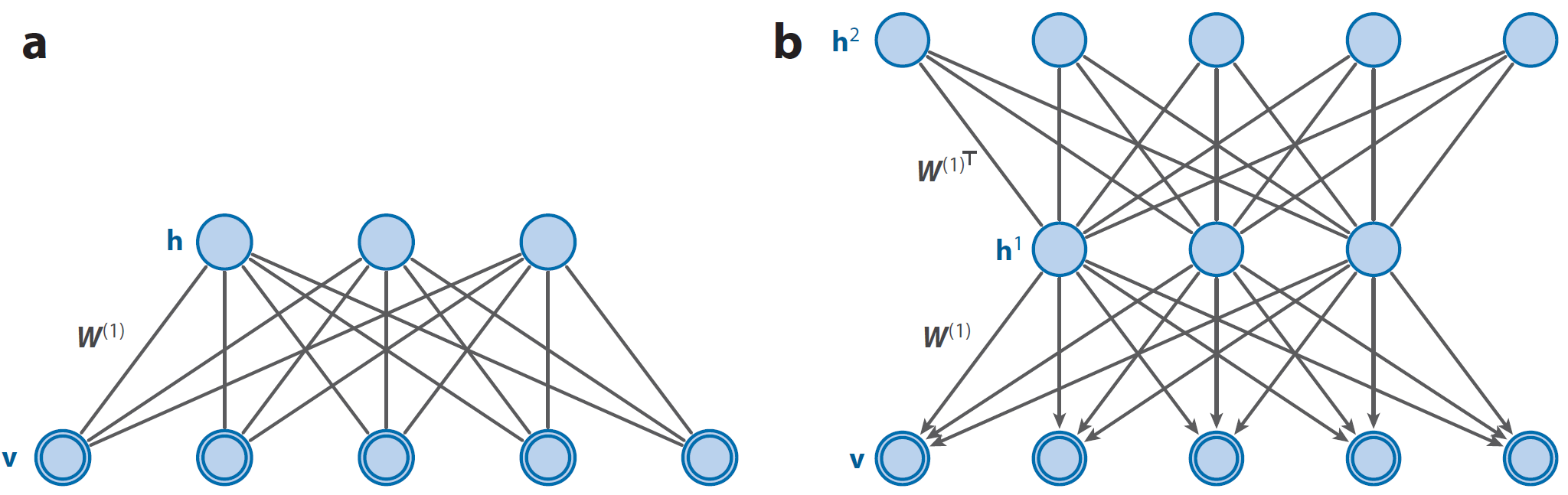

- 顶层是 RBM,具有对称性,权重 W 在正向和反向传播中都是对成存在的

- 下层是 sigmoid 信念网络,自上而下地将抽象的数据生成为可见数据

结构上可以对比 VAE ,上层类似于隐变量空间,用向量建模全局分布,下层类似于解码器,用于将隐变量空间解码成有效信息。

下层的 sigmoid 信念网络与 RBM 有一些不同,就是它是有向连接的,并且使用 sigmoid 函数计算激活来输出。

简单的例子

以上是一个两层的 DBN,上层是无向的 RBM,下层是有向的 sigmoid 信念网络。

该两层 DBN 的概率分布为:

- 表示 sigmoid 的有向输出部分

- 表示无向的 RBM 部分

对以上的概率分布,自下而上的计算过程为:

sigmoid 有向信念网络的计算:

隐藏层的联合分布:

逐层训练策略(贪心策略)

可见图中的 h1 层是两个网络共享的连接层,基于这一点,可以得知在 h1 作为“中介”连接的情况下,上下部分的网络可以分开训练。

这里有一个等效性的思考:就是在训练 DBN 时,如果把上层网络的权重初始化为与下层网络相同, 整体网络的性能与单层网络的性能相当(至少不会更差),所以可以在一层训练完成的情况下,固定参数,然后优化另一层。在整个优化过程结束后,整体网络的性能将达到最优。