Bidirectional Encoder Representations from Transformers,双向表征编码器

ref:

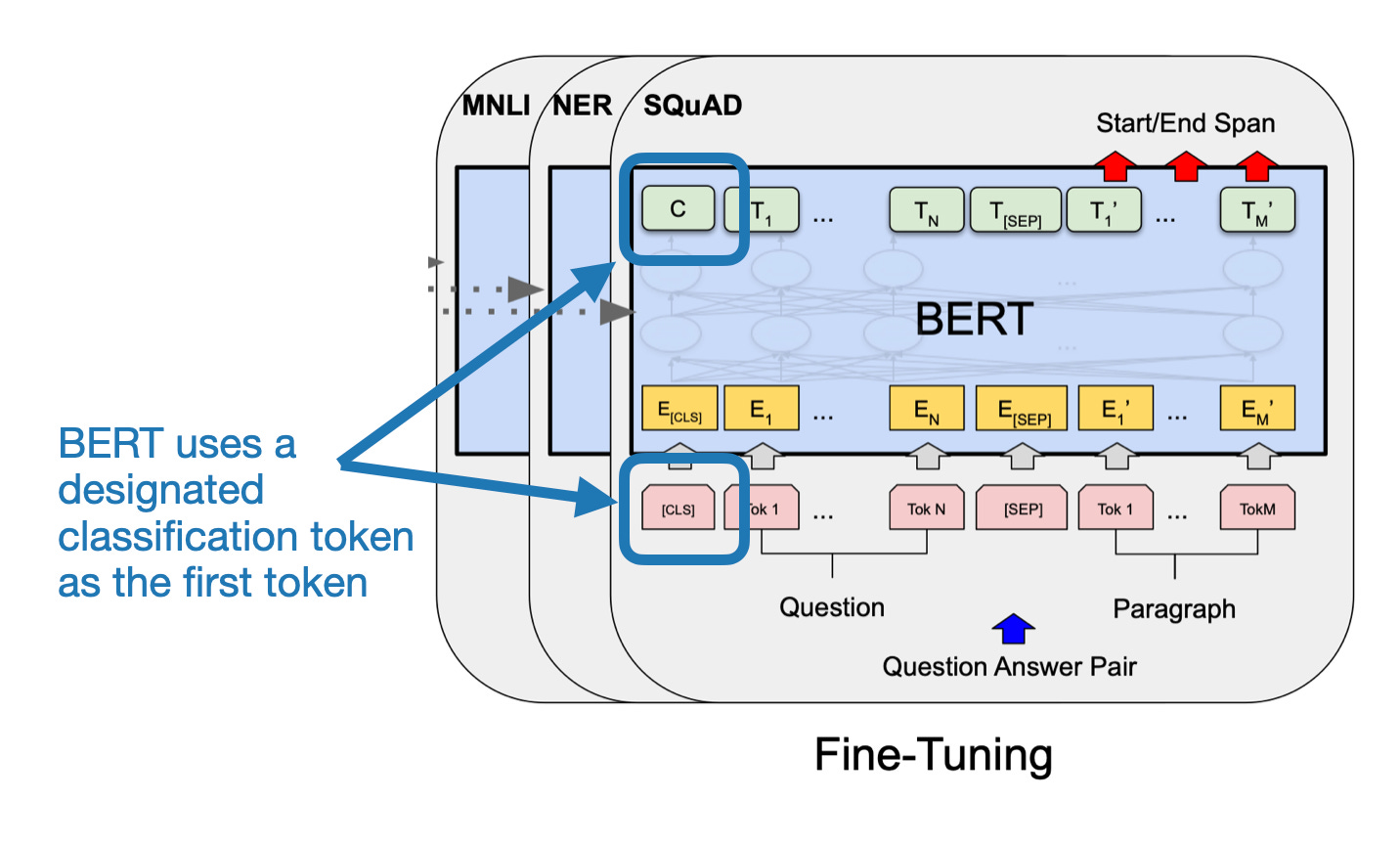

BERT 实际上就是利用了 Transformer 的 Encoder 部分,包含:

- 多头自注意力网络

- 前馈网络 FFN

几个理解:

- 双向:注意力的计算是双向并非单向的,意味着 BERT 算法能够完整理解单句句子的完整上下文

- 编码:对语言文本编码,即为 BERT 最终输出的是句子语义上下文的抽象表示。

总而言之,就是“对自然语言的编码器”。

BERT 的应用场景和 GPT 有所不同,BERT 更倾向于对语义的编码理解。

如果说 GPT 仅使用 Decoder,善于生成,那么 BERT 仅使用 Encoder ,善于理解。

所以 BERT 一般用于分类任务,或者理解任务使用。