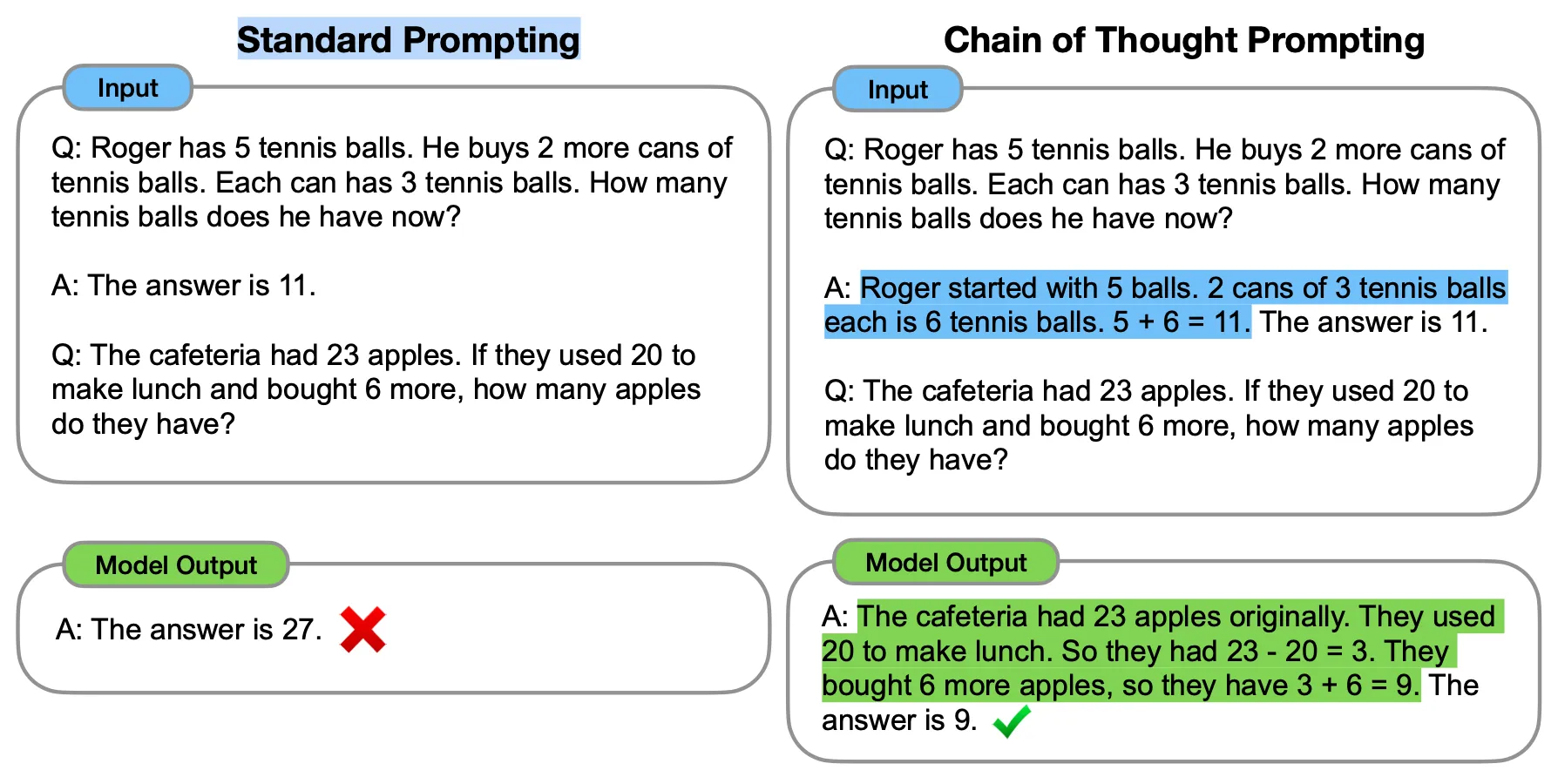

CoT = Chain of Thought

在提示词中,让语言模型分步骤处理用户的请求,往往会有更好的效果。

实时反馈和目标对齐

在实际使用 CoT 的过程中,从使用的直观效果上看,CoT 对问题做了分步拆解,用户可以看到语言模型思考的每一个步骤,在每一个步骤中做出及时的反馈,在过程中把控语言模型的思维方向。

我将其看作是用户深度参与到 AI 协作中的一个过程,使得 AI 的目标在思维链过程中不断获得调整和用户的目标做对齐。

在Zhiyuan Li, Chain of Thought.这里,看到思维链的上限是 P-问题的超集。

局限性

CoT 可以实现语言模型在思维逻辑上的推理,但是也要注意一个问题,那就是梯度爆炸的幻觉问题。如果说语言模型可以在单个步骤上出现幻觉,那么经过思维链的扩展,幻觉问题可能会堆积然后出现更为离谱的效果。